我建造的

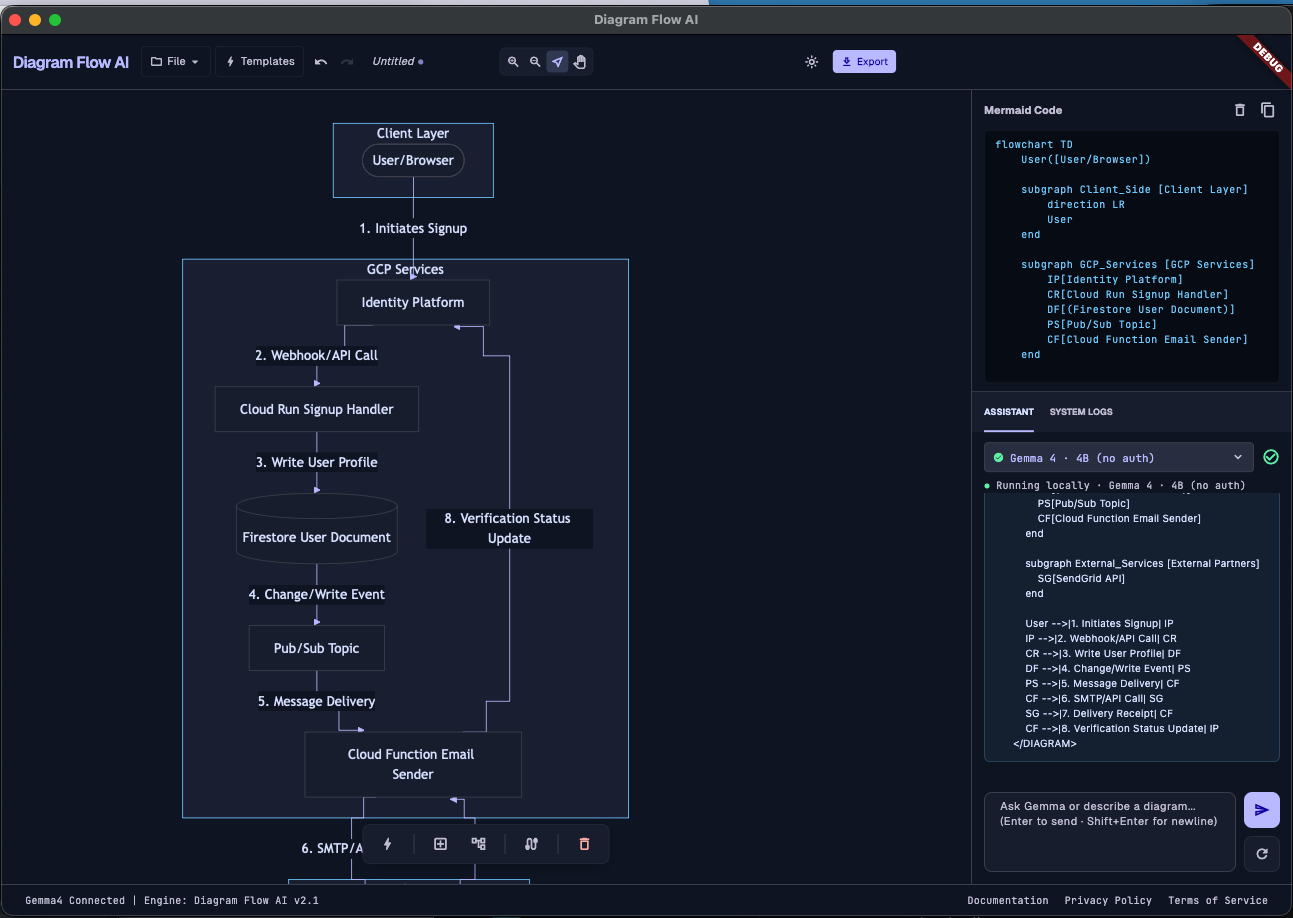

DiagramFlowAI 是一款本機優先的桌面應用程式(支援 macOS、Windows 和 Linux),可將自然語言描述轉換為可用於生產環境的架構圖。它能夠智慧地產生標準的 Mermaid 語法以用於通用工作流程,或輸出映射到官方 AWS 圖示的結構化命令以用於雲端架構。

此應用解決了現代軟體工程中一個非常具體的難題:隱私與生產力之間的平衡。當架構師和工程師設計內部系統(例如身份驗證流程、專有資料管道或安全雲端邊界)時,將這些資料傳送到基於雲端的LLM端點通常會成為合規性方面的一個重大障礙。

DiagramFlowAI 的設計理念是完全獨立運作。它基於flutter_gemma和 LiteRT 建置,100% 本地執行。初始模型下載完成後,它無需任何網路連接,不使用 API 金鑰,也不會收集任何遙測資料。它是一款尊重您公司安全策略的 AI 圖表繪製工作室。

示範

程式碼

github.com/carlosrgomes/DiagramFlowAI

我如何使用 Gemma 4

大多數人工智慧演示都預設使用最大的可用模型。我的做法恰恰相反。我特意圍繞Gemma 4 的 E2B 和 E4B (邊緣變體)建置了 DiagramFlowAI,並有意跳過了 310 億的 Dense 模型和 260 億的 MoE 模型。本文將闡述為什麼最小的變體是這款桌面應用程式成功運作的關鍵,以及 Gemma 4 的「思考模式」如何解鎖了我意想不到的功能。

不合時宜的選擇:小號勝過大號

如果你要建造高吞吐量的後端,31B Dense 或 26B MoE 顯然是最佳選擇。然而,我的部署限制指向了一個完全不同的方向:

-

民主化的硬體需求:一個 31 位元組、4 位元量化的密集型模型需要大約 16-20 GB 的記憶體。而 E4B 模型只需 4-6 GB 記憶體即可輕鬆執行,並且能夠在整合式顯示卡上流暢執行。這就是人人都能使用的應用和僅限於高端工作站的玩具之間的差異。

-

無縫註冊:一旦用戶需要貼上 API 金鑰,註冊轉換率就會直線下降。由於 E2B 和 E4B 是開放的權重,使用者只需點擊「下載」即可開始繪製圖表。無需身份驗證,無需設定計費。

-

快速冷啟動:在桌面應用中,首次互動必須即時回應。 E2B 模型在現代 M 系列 Mac 和現代 PC 上可在數秒內載入並回應,讓使用者保持流暢的操作狀態。

為了提供使用者靈活性,我內建了一個 E2B(速度更快)和 E4B(處理複雜語法時更準確)之間的切換功能,而不是硬編碼單一選項。

被低估的超級大國:思考模式

如果說使用 Gemma 4 的開發者應該掌握什麼核心知識,那就是推理追蹤的強大功能。 flutter_gemma SDK 將 Gemma flutter_gemma的內部推理過程以ThinkingResponse資料塊流的形式公開出來。

對於圖表生成而言,這可謂是顛覆性的。 Mermaid 語法出了名的脆弱——一個多餘的冒號、一個未加引號的字串,或是一個缺少的end標籤,都會導致整個渲染失敗。如果沒有“思考模式”,4B 參數模型往往會一次輸出語法錯誤的 DSL。

啟用思考模式後,模型會先花費數百個代幣來規劃其結構(「好的,這是一個序列圖,我需要參與者 -> 參與者 -> 箭頭 -> 回應…」)。因此,最終輸出的可靠性顯著提高。

在使用者介面中,我將此追蹤資訊以折疊面板的形式呈現(例如,「正在思考 · 2.4 秒」)。這種巧妙的使用者體驗設計能夠建立使用者信任,並使生成等待過程顯得高效,而不會讓使用者被原始日誌資訊淹沒。

4B 模型實用模式

在與模型搏鬥幾週後,我終於總結了一些來之不易的建築模式:

-

將系統提示視為語法,而非個性:小型模型在模式匹配方面表現出色。我編寫的 500 行系統提示並非旨在讓 AI “更有幫助”,而是一份輸出契約。我使用明確的分隔符號(

<DIAGRAM>...</DIAGRAM>),並提供「語法卡片」來展示最常見的解析錯誤(例如,NEVER write X)。教會模型哪些事情不該做,可以避免整類錯誤。 -

信任契約而非正規表示式:與其用複雜的正規表示式來對抗脆弱的 Markdown 程式碼區塊,我更傾向於使用系統提示符號中定義的 XML 風格分隔符號。即使模型需要編寫解釋性段落,實際程式碼也會被安全地封裝起來,並且易於提取。

-

設計恢復循環:即使開啟了思考模式,複雜的圖表偶爾會解析失敗。與其嘗試透過提示設計來實現 100% 的成功率(這在 4B 等級幾乎不可能),我建立了一個類似 ReAct 的小型重試循環。如果 Mermaid 解析器拋出錯誤,應用程式會將完整的錯誤訊息回饋到後續回合。模型幾乎總是能在第二次嘗試時修復語法錯誤。

Gemma 4 E2B 和 E4B 證明,無需龐大的雲端託管 LLM 即可交付真正實用、結構化的 AI 應用程式。只要明確部署限制,充分利用系統提示,啟用“思考模式”,並建立智慧恢復循環,這些邊緣模型就能成為優勢,而非妥協。

1) --- 會變成分隔線(上一行必須是空白)

2) # 會變成一級標題

3) ## 會變成二級標題

4) ### 會變成三級標題

5) **粗體文字**會顯示粗體文字

6) ```當第一行與最後一行會顯示程式碼

7) 請搜尋 Markdown 語法,了解各種格式